단순한 코드 생성을 넘어, 개발자의 컴퓨터 환경을 직접 제어하고 명령을 수행하는 행동주의 AI(Behavioral AI)의 등장은 개발 생태계에 큰 충격을 주었습니다. 그 중심에 선 오픈클로(OpenClaw)는 클로드 코워크(Claude Co-work)보다도 더 뜨거운 감자로 부상하며, 개발자들에게 24시간 가동되는 무보수 가상 직원이라는 환상을 현실로 바꾸어 놓았습니다. 하지만 이 혁신적인 도구는 강력한 편의성만큼이나 치명적인 보안 리스크를 동시에 안고 있습니다.

개발자의 시각에서 오픈클로가 실질적으로 어디까지 도달했는지, 그리고 우리가 마주한 한계는 무엇인지 심층적으로 분석해 봅니다.

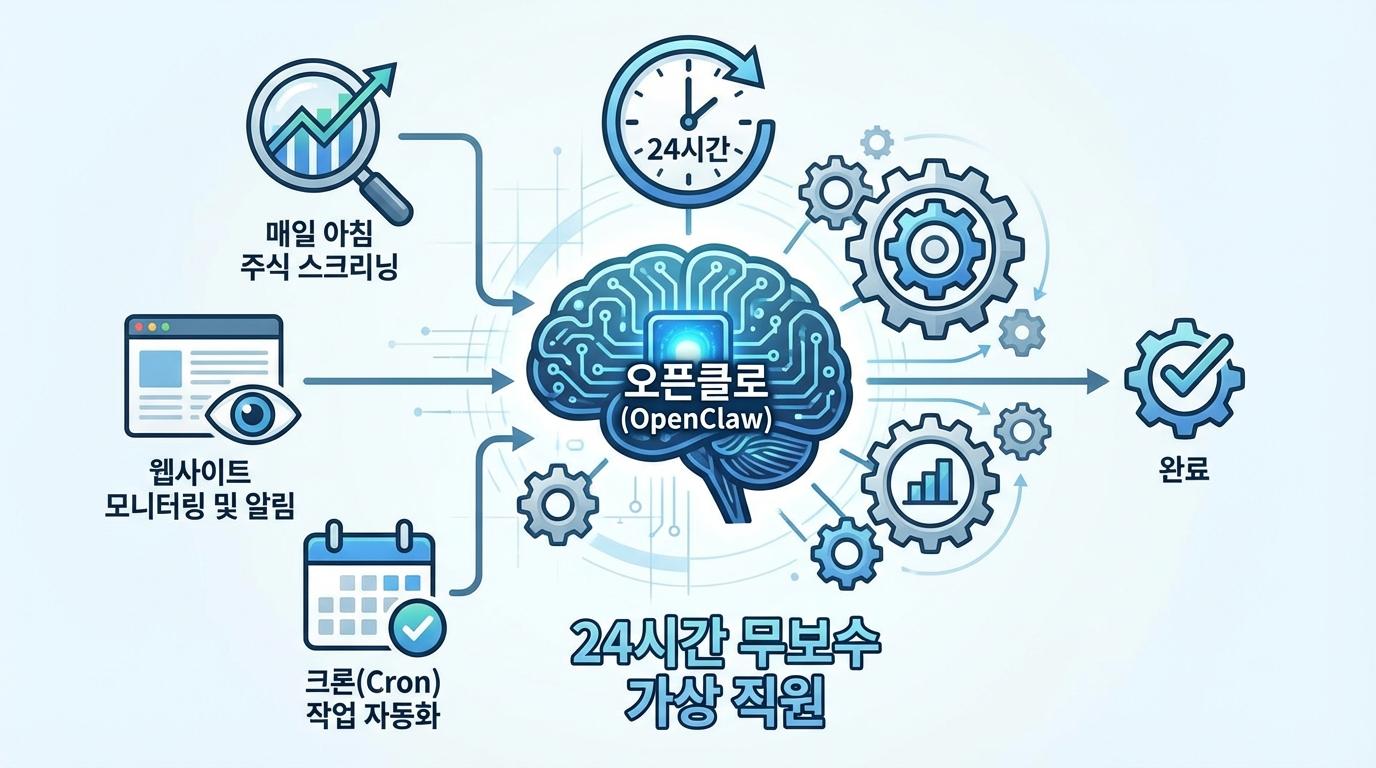

AI가 여는 개발의 신세계: 24시간 일하는 무보수 가상 직원을 만나다

오픈클로의 가장 큰 강점은 복잡한 코딩 과정 없이 자연어(Human Language)만으로 나만의 업무 프로세스를 구축할 수 있다는 점입니다. 과거에는 특정 조건에서 동작하는 자동화 툴을 만들기 위해 별도의 스크립트를 작성하고 라이브러리를 연동해야 했지만, 이제는 텔레그램이나 메시지로 명령만 내리면 AI가 알아서 코드를 생성하고 실행까지 완료합니다.

특히 주기적으로 실행되는 크론(Cron) 작업 기능은 매우 인상적입니다. "매일 아침 8시에 특정 주식 종목을 스크리닝해 리포트를 보내줘"라거나 "경쟁사 웹사이트를 모니터링하다가 가격 변동이 생기면 알려줘"와 같은 명령을 한 번만 내려두면, AI가 24시간 내내 개발자 대신 시스템을 감시하고 업무를 처리합니다. 이는 단순한 도구를 넘어 마치 수십 명의 주니어 개발자를 거느린 것과 같은 생산성의 비약적 상승을 의미합니다.

장애물 앞에서도 멈추지 않는 AI의 집념: 스스로 문제를 해결합니다

기존의 챗봇은 오류가 발생하면 "수행할 수 없습니다"라는 답변으로 상황을 종료했지만, 오픈클로는 문제 해결에 대한 탁월한 집요함을 보여줍니다. 예를 들어, 특정 웹사이트에서 자동화 프로그램을 감지하여 브라우저 접속을 차단하면, 오픈클로는 스스로 판단하여 브라우저 방식이 아닌 HTTP API 호출로 방식을 변경하거나 다른 우회 경로를 찾아내어 임무를 완수합니다.

심지어 서버(VPS) 환경에서 유튜브 자막 추출이 막히자, 개발자의 로컬 PC에 설치된 노드(Node)를 통해 원격으로 접속하여 자막을 추출해 오는 멀티 노드 제어 능력까지 선보입니다. 이처럼 '생각하고 행동하는' 능력은 개발자가 일일이 예외 처리를 하지 않아도 AI가 상황에 맞춰 능동적으로 대응하는 새로운 차원의 자동화를 가능하게 합니다.

편의성 뒤에 숨겨진 치명적인 그림자: 오픈클로의 보안 악몽

하지만 개발자 입장에서 오픈클로는 보안의 악몽이 될 수도 있습니다. 오픈클로는 시스템의 모든 권한을 요구하며, 설치 과정에서 윈도우 보안 시스템이 이를 악성 코드로 간주하고 차단할 정도로 강력한 접근권을 가집니다. 가장 심각한 문제는 민감 정보의 취급 방식입니다. 사용자의 API 키나 텔레그램 비밀번호 등이 설정 파일 내에 암호화되지 않은 텍스트 그대로 저장되어 노출되는 경우가 확인되었습니다.

실제로 몰트북(MoltBot) 플랫폼을 통해 약 150만 개의 API 키와 수만 개의 개인 메시지가 유출된 사례가 있으며, 이는 개발자의 소중한 자산인 API 크레딧이 무단으로 사용되거나 시스템 전체가 해킹당할 수 있는 심각한 위험을 시사합니다. 시스코 AI 보안 팀이 이 툴을 두고 "완벽한 악몽"이자 "악성 코드와 같다"고 표현한 이유는 바로 이 때문입니다.

위험을 관리하며 혁신을 취하는 길: 현명한 공존 전략

따라서 숙련된 개발자들은 오픈클로의 강력함을 취하되 위험을 최소화하기 위해 망 분리(Air-gapping) 전략을 사용합니다. 소중한 데이터가 담긴 메인 작업용 PC에 직접 설치하는 대신, 별도의 맥미니(Mac Mini)를 구매하거나 가상 머신(VM), WSL(Windows Subsystem for Linux) 환경을 구축하여 그 안에서만 AI가 활동하도록 격리하는 방식입니다.

이렇게 하면 AI가 실수로 파일을 삭제하거나 해킹 위협에 노출되더라도 본진인 메인 시스템은 안전하게 보호할 수 있습니다. 기술의 초기 단계인 만큼, 무조건적인 수용보다는 실패해도 괜찮은 환경(Sandbox)에서 작은 업무부터 차근차근 맡기며 AI와 손발을 맞춰가는 보수적인 접근이 필수적입니다.

댓글 (0)

댓글 쓰기